- Accueil

- Blog

- Référencement Naturel et SEO

- Comment faire un Audit SEO Technique ?

Comment faire un Audit SEO Technique ?

Les optimisations techniques du référencement naturel de votre site Web sont essentiels aux performances de votre SEO. Si vous les comprenez et les entretenez convenablement, votre site Web pourra se classer en bonne place, générer du trafic et contribuer à stimuler les ventes. Si vous les négligez, vous courez le risque que des pages n’apparaissent pas dans les SERPs (Search Engine Result Page, autrement dit les pages de résultats de moteur de recherche).

Dans cet article, vous allez apprendre à réaliser un audit technique de SEO pour trouver et résoudre les problèmes de structure de votre site Web. Nous examinerons les principaux facteurs de classement, notamment le contenu, la vitesse, la structure et la convivialité mobile, afin de nous assurer que votre site peut être exploré et indexé comme il se doit.

Nous vous montrerons également les outils dont vous aurez besoin pour stimuler les efforts et les performances du référencement naturel on-page et off-page de votre site et comment les utiliser.

Réaliser un audit SEO technique pour améliorer votre référencement naturel

Considérez un audit technique SEO comme un bilan de santé du site Web.

Tout comme vous passez périodiquement en revue vos campagnes de marketing numérique pour en tirer le meilleur parti, un audit technique SEO évalue les performances du site pour identifier les domaines à améliorer.

Ces domaines se répartissent en trois catégories :

1. Les erreurs techniques

Identifier les drapeaux rouges dans le back-end et le front-end de votre site Web qui ont un impact négatif sur les performances et, par conséquent, sur votre référencement Google. Les erreurs techniques comprennent les problèmes d’indexation, les liens brisés, la lenteur du site et le contenu dupliqué. Nous allons examiner chacune de ces erreurs dans cet article.

2. Les erreurs UX

On a tendance à considérer l’expérience utilisateur (UX) comme une question de conception plutôt que de référencement Google. Cependant, la structure de votre site Web a un impact sur les performances du référencement Google.

L’importance d’une page est déterminée par le type de page, les liens internes et externes, la fréquence des mises à jour et votre sitemap. Mais, plus important encore du point de vue de l’ergonomie, elle est déterminée par la position de la page. En d’autres termes, l’emplacement de la page sur votre site.

Cela fait de l’architecture du site un important facteur de référencement technique SEO off-page. Plus il est difficile pour un utilisateur de trouver une page, plus il faudra de temps à Google pour la trouver. Idéalement, un utilisateur devrait pouvoir se rendre à l’endroit voulu en aussi peu de clics que possible.

Un audit de référencement SEO aborde les problèmes de structure et d’accessibilité du site qui l’empêchent d’y parvenir.

Il est à noter que l’UX est devenu un crière de classement très important pour Google, nous l’avions annoncé dans une publication en juin 2021, et depuis cela se confirme de plus en plus avec les diverses mises à jours de l’algorithme de Google.

3. Opportunités de classement

C’est ici que la technique SEO rencontre le SEO on-page. En plus de donner la priorité aux pages clés de l’architecture de votre site, un audit permet de convaincre Google de l’importance d’une page :

- Identifiant et fusionnant le contenu ciblant les mêmes mots-clés ou des mots-clés similaires ;

- Supprimant le contenu dupliqué qui dilue l’importance ;

Améliorant les métadonnées afin que les utilisateurs voient ce qu’ils recherchent dans les pages de résultats des moteurs de recherche (SERP).

Il s’agit d’aider Google à mieux comprendre votre site Web afin que les pages s’affichent pour les bonnes recherches.

Comme tout contrôle de santé, un audit technique de référencement naturel ne doit pas être réalisé une fois pour toutes. Il doit être réalisé lors de la création ou de la refonte de votre site Web, après tout changement de structure et périodiquement.

La règle générale est d’effectuer un mini-audit chaque mois et un audit plus approfondi chaque trimestre.

Si vous vous en tenez à cette routine, vous pourrez suivre et comprendre comment les modifications apportées à votre site Web affectent les performances du référencement Google.

6 outils pour vous aider à réaliser un audit SEO technique

Voici les outils de référencement naturel que nous utiliserons pour réaliser un audit technique :

- Screaming Frog SEO Spider

- Google Search Console

- Google Analytics

- Google Page Speed Insights

- Google Mobile-Friendly Test

- BrowserStack Responsive Test

Ces outils sont gratuits, à l’exception de Screaming Frog qui limite les utilisateurs du plan gratuit à 500 pages.

Si vous gérez un grand site Web de plus de 500 pages, la version payante de Screaming Frog offre un crawling illimité pour 129 euros par an.

Vous pouvez également utiliser l’outil d’audit de site de Semrush (gratuit jusqu’à 100 pages) ou l’outil d’audit de site d’Ahrefs. Ces deux outils effectuent un travail similaire, avec les avantages supplémentaires de la signalisation des erreurs et des avertissements et des instructions sur la façon de résoudre les problèmes techniques.

Besoin d’un Audit SEO Technique ?

1. Trouvez votre fichier robots.txt et lancez un rapport d’exploration pour identifier les erreurs.

Les pages de votre site Web ne peuvent être indexées que si les moteurs de recherche peuvent les explorer. Aidez les moteurs de recherche à les esplorer.

Par conséquent, avant d’exécuter un rapport d’exploration, consultez votre fichier robots.txt. Vous pouvez le trouver en ajoutant « robots.txt » à la fin de votre domaine racine : Exemple : votre-site-web.com/robots.txt

Si vous n’en avez pas, il faut en créer un.

Le fichier robots.txt est le premier fichier qu’un robot trouve lorsqu’il atterrit sur votre site. Les informations qu’il contient lui indiquent ce qu’il doit ou ne doit pas explorer en l’autorisant ou en l’interdisant.

Consultez votre fichier robots.txt pour vous assurer que les robots n’explorent pas des dossiers et des pages privés. De même, vérifiez que vous ne refusez pas des pages qui devraient être indexées.

Si vous devez apporter des modifications à votre fichier robots.txt, vous le trouverez dans le répertoire racine de votre serveur Web (si vous n’êtes pas habitué à ces fichiers, cela vaut la peine de demander l’aide d’un développeur Web).

Si vous utilisez WordPress ou d’autres plateformes CMS, vous pourrez effectuer des modifications à l’aide d’outils SEO intégrés.

Exécutez un rapport d’exploration pour vérifier que votre site Web est indexable.

Maintenant que vous savez que les robots reçoivent les bonnes instructions, vous pouvez lancer un rapport d’exploration pour vérifier que les pages que vous souhaitez indexer ne sont pas entravées.

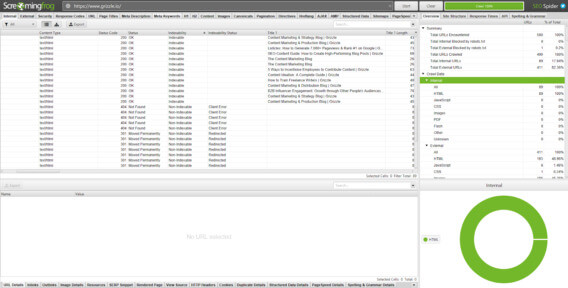

Saisissez votre URL dans Screaming Frog, ou en allant dans Index > Couverture dans votre Google Search Console.

Chacun de ces outils affichent les mesures de manière différente.

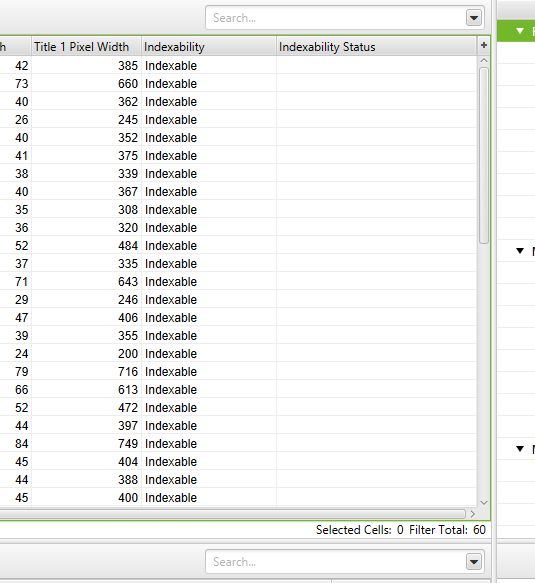

Screaming Frog examine chaque URL individuellement et divise les résultats de l’indexation en deux colonnes :

- Indexabilité : Cela montre où une URL est indexable ou non indexable.

- Statut d’indexabilité : La raison pour laquelle une URL est non-indexable.

Signalez et corrigez les erreurs de redirection pour améliorer l’exploration et l’indexation.

Un code d’état HTTP est attribué à toutes les pages de votre site Web. Chaque code correspond à une fonction différente.

Si tout va bien, la plupart des pages de votre site Web renverront un code d’état 200, ce qui signifie que la page va bien. Les pages présentant des erreurs afficheront un code d’état 3xx, 4xx ou 5xx.

Voici un aperçu des codes que vous pourriez voir dans votre audit et comment corriger ceux qui sont importants :

Codes d’état 3xx

- 301 : Redirection permanente. Le contenu a été déplacé vers une nouvelle URL et la valeur SEO de l’ancienne page est transmise.

Les 301 sont acceptables, à condition qu’il n’y ait pas de chaîne ou de boucle de redirection qui entraîne des redirections multiples. Par exemple, si la redirection 1 va vers la redirection 2 et 3 pour arriver à 4, l’expérience de l’utilisateur peut être médiocre et la vitesse de la page lente. Cela peut augmenter le taux de rebond et nuire aux conversions. Pour résoudre ce problème, vous devez supprimer les redirections 2 et 3 afin que la redirection 1 mène directement à 4.

- 302 : Redirection temporaire. Le contenu a été déplacé vers une URL de façon temporaire.

Les 302 sont utiles à des fins telles que les tests A/B, lorsque vous souhaitez tester un nouveau modèle ou une nouvelle mise en page. Toutefois, si la redirection 302 est en place depuis plus de trois mois, il est préférable de la transformer en 301.

- 307 : Redirection temporaire due à un changement de protocole entre la source et la destination.

Cette redirection doit être utilisée si vous êtes sûr que le changement est temporaire et que vous aurez toujours besoin de l’URL d’origine.

Codes d’état 4xx

- 403 : Accès interdit. Ce code tend à s’afficher lorsque le contenu est caché derrière un login.

- 404 : La page n’existe pas en raison d’un lien brisé ou lorsqu’une page ou un article a été supprimé mais que l’URL n’a pas été redirigé.

Comme les chaînes de redirection, les 404 ne constituent pas une bonne expérience pour l’utilisateur. Supprimez tous les liens internes pointant vers les pages 404 et mettez-les à jour avec le lien interne redirigé.

- 410 : Page définitivement supprimée.

Vérifiez toute page affichant une erreur 410 pour vous assurer qu’elle est définitivement supprimée et qu’aucun contenu ne peut justifier une redirection 301.

- 429 : Trop de demandes au serveur dans un court laps de temps.

Codes d’état 5xx

Tous les codes d’état 5xx sont liés à une erreur du serveur. Ils indiquent que le serveur a rencontré une erreur interne. Bien qu’il faille y prêter attention, le problème se situe au niveau de votre fournisseur d’hébergement ou de votre développeur web et non de votre site web.

En regardant les logs du servuer, vous allez trouver plus d’informations sur l’erreur rencontrée.

Configurez des balises canoniques pour orienter les moteurs de recherche vers les pages importantes

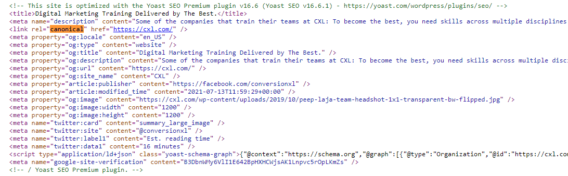

Les balises méta canoniques apparaissent dans la section <head> du code d’une page.

Elles existent pour permettre aux robots des moteurs de recherche de savoir quelle page indexer et afficher dans les SERP lorsque vous avez des pages au contenu identique ou similaire.

Par exemple, supposons qu’un site de commerce électronique vende une voiture de police en jouet bleue et qu’il soit répertorié sous « jouets > voitures > voiture de police en jouet bleue » et « jouets > voitures de police > voiture en jouet bleue ».

Il s’agit de la même voiture de police bleue sur les deux pages. La seule différence réside dans les liens du fil d’Ariane qui vous mènent à la page.

En ajoutant une balise canonique à la « page principale » (jouets > voitures), vous signalez aux moteurs de recherche qu’il s’agit du produit original. Le produit listé à « jouets > voitures de police > voiture bleue » est une copie.

Un autre exemple d’ajout de balises canoniques est celui des pages auxquelles des paramètres d’URL ont été ajoutés.

Sans balise canonique, les moteurs de recherche traiteraient chaque page comme unique. Cela signifie non seulement que plusieurs pages sont indexées, ce qui réduit la valeur du référencement SEO de votre page principale, mais aussi que votre budget d’exploration augmente.

Les balises canoniques peuvent être ajoutées directement à la section <head> dans le code de la page des pages supplémentaires (pas la page principale) ou si vous utilisez un CMS comme WordPress ou Magneto, des plugins comme Yoast SEO ou Rank Math SEO qui rendent le processus simple.

2. Révisez l’architecture de votre site et la sitemap pour rendre le contenu accessible.

L’exécution d’un crawl du site permet de résoudre la plupart des erreurs techniques sur votre site Web. Nous devons maintenant nous pencher sur les erreurs de l’interface utilisateur.

Comme nous l’avons mentionné au début, un utilisateur doit pouvoir se rendre à l’endroit où il souhaite se trouver sur votre site en quelques clics. Une expérience humaine plus facile est synonyme d’une expérience plus facile pour les robots de recherche (ce qui, là encore, permet d’économiser sur le budget de crawl).

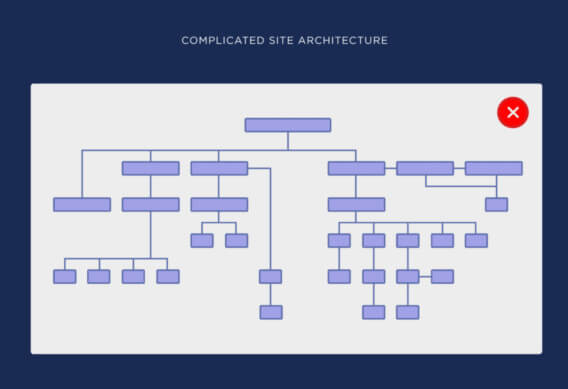

La structure de votre site doit être logique et cohérente. Vous y parviendrez en aplatissant l’architecture de votre site.

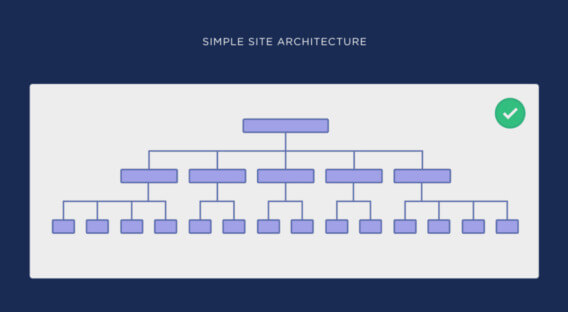

Voici des exemples d’architecture de site compliquée et d’architecture de site simple (plate) tirés du guide de Backlinko sur le sujet :

Vous pouvez voir à quel point il est plus facile dans la deuxième image de se rendre de la page d’accueil à n’importe quelle autre page du site.

Plus une page est proche de votre page d’accueil, plus elle est importante.

Par conséquent, vous devez chercher à regrouper les pages en fonction des mots clés afin de faire remonter les plus pertinentes pour votre public vers le haut du site.

Une architecture de site Web aplatie doit se refléter dans sa structure des URL.

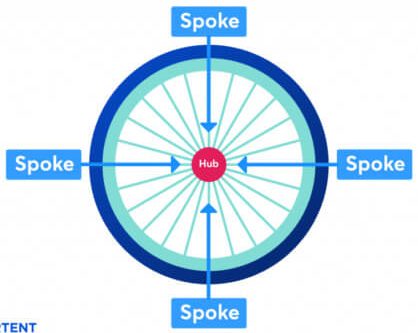

Pour créer une stratégie de référencement naturel cohérente et organiser la relation entre les éléments de contenu, utilisez la méthode « hub-and-spoke« .

Cette méthode décrite comme « une stratégie de liens internes qui consiste à relier plusieurs pages de contenu connexe (parfois appelées pages « rayons ») à une page centrale ».

Selon la taille de votre site Web, vous aurez peut-être besoin de l’aide d’un développeur Web pour aplanir l’architecture et remanier la navigation. Cependant, vous pouvez facilement améliorer l’expérience utilisateur en ajoutant des liens internes vers les pages pertinentes.

Organisez votre plan du site pour refléter la structure de votre site Web

Les URL qui figurent sur votre site doivent correspondre à celles de votre plan de site XML. Il s’agit du fichier que vous devez indiquer aux robots dans votre fichier robots.txt pour les guider dans l’exploration de votre site Web.

Comme pour robots.txt, vous pouvez trouver votre sitemap XML en ajoutant « sitemap.xml » à la fin de votre domaine racine : votre-site-web.com/sitemap.xml

Si vous mettez à jour l’architecture de votre site, votre sitemap devra également être mis à jour. Un CMS comme WordPress, Google XML sitemaps peut générer et mettre à jour automatiquement un sitemap à chaque fois qu’un nouveau contenu est créé. D’autres plateformes comme Wix et Squarespace ont également des fonctions intégrées qui font la même chose.

Si vous devez le faire manuellement, XML-sitemaps générera automatiquement un sitemap XML que vous pourrez coller dans le dossier (/) de votre site Web. Toutefois, vous ne devez procéder de la sorte que si vous savez manipuler ces fichiers. Dans le cas contraire, demandez l’aide d’un développeur web.

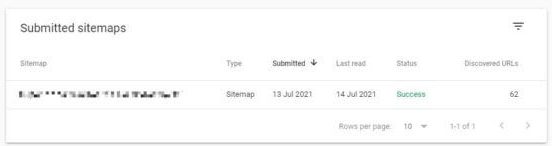

Une fois que vous avez mis à jour votre sitemap, soumettez-le dans Index > Sitemaps dans la console de recherche Google.

À partir de là, Google signalera tout problème d’accessibilité et d’indexation.

Les sitemaps fonctionnels affichent un statut de « réussite ». Si l’état indique « Has errors » ou « Couldn’t fetch », il est probable que le contenu du sitemap pose problème.

Comme pour votre fichier robots.txt, votre sitemap ne doit pas inclure les pages que vous ne souhaitez pas voir apparaître dans les SERPs. En revanche, il doit inclure toutes les pages que vous souhaitez voir indexées, exactement comme elles apparaissent sur votre site.

Par exemple, si vous souhaitez que Google indexe « votre-site-web.com/jouets », votre sitemap doit copier exactement ce domaine, y compris le protocole HTTPS. Si vous utilisez « votre-site-web.com/jouets » ou « /jouets », les pages ne seront pas explorées.

3. Testez et améliorez la vitesse du site et sa réactivité aux mobiles

La vitesse du site est depuis longtemps un facteur de classement dans les moteurs de recherche. Google l’a confirmé pour la première fois en 2010.

En 2018, ils ont fait monter les enchères en déployant la vitesse des pages mobiles comme facteur de classement dans les résultats de recherche mobile.

Lorsqu’il classe un site Web en fonction de sa vitesse, Google examine deux points de données :

- La vitesse de la page : le temps qu’il faut à une page pour se charger.

- La vitesse du site : le temps moyen de chargement d’un échantillon de pages vues.

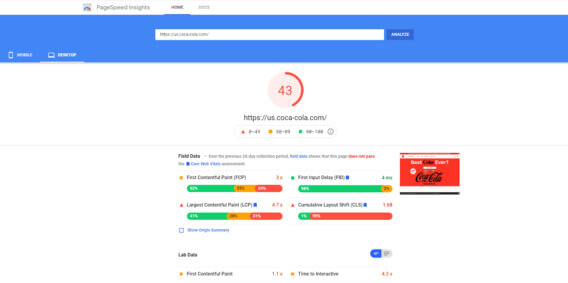

Lors de l’audit de votre site, vous devez vous concentrer uniquement sur la vitesse des pages. Améliorez le temps de chargement des pages et vous améliorerez la vitesse du site. Google vous aide à le faire grâce à son analyseur PageSpeed Insights.

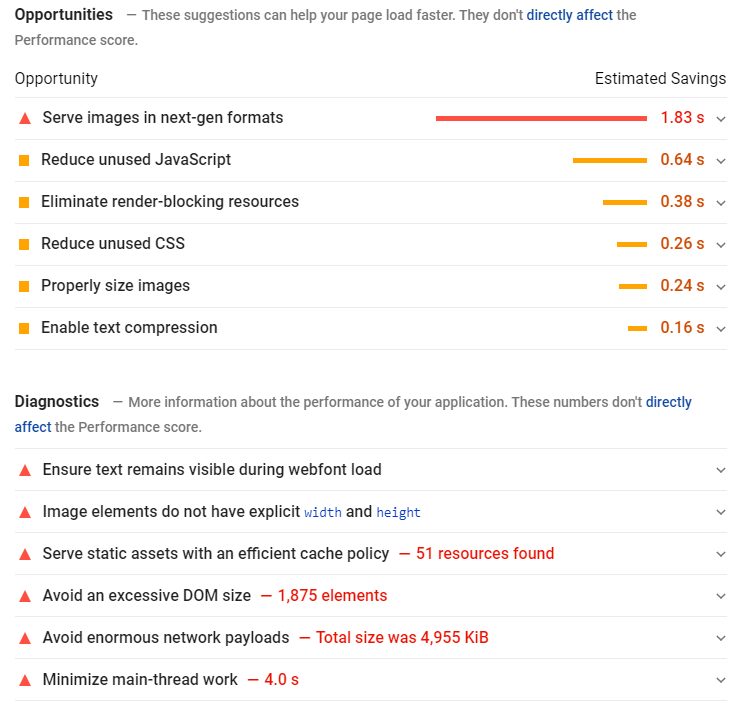

Saisissez une URL et PageSpeed Insights lui attribuera une note de 0 à 100. La note est basée sur des données réelles recueillies sur le terrain auprès des utilisateurs du navigateur Google Chrome et sur des données de laboratoire. Il suggère également des possibilités d’amélioration.

Les mauvaises pratiques d’optimisation des images, du JavaScript, des fichiers CSS et de la mise en cache du navigateur sont souvent à l’origine de la lenteur du chargement des pages. Heureusement, il est facile de les améliorer :

- Réduisez la taille des images sans nuire à la qualité avec Optimizilla ou Squoosh. Si vous utilisez WordPress, des plugins d’optimisation comme Imagify Image Optimizer et TinyPNG font le même travail.

- Réduisez les fichiers JavaScript et CSS en collant votre code dans Minify pour supprimer les espaces blancs et les commentaires.

- Si vous utilisez WordPress, utilisez W3 Total Cache ou WP Super Cache pour créer et servir une version statique de vos pages aux chercheurs, plutôt que d’avoir une page générée dynamiquement chaque fois qu’une personne clique dessus. Si vous n’utilisez pas WordPress, la mise en cache peut être activée manuellement dans le code de votre site.

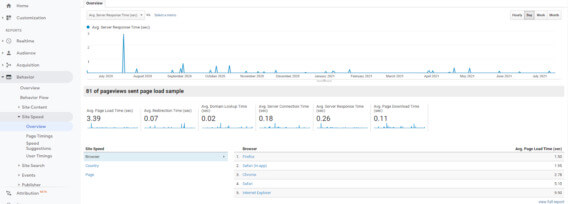

Commencez par donner la priorité à vos pages les plus importantes. En allant dans la section Comportement > Vitesse du site de votre Google Analytics, des mesures vous montreront comment des pages spécifiques se comportent sur différents navigateurs et pays.

Si vous voulez approfondir le sujet de la vitesse de chargement d’un site, nous avons publié un guide expert spécialement à cet effet.

Comment savoir si votre site Web est adapté aux mobiles ?

En mars 2021, Google a lancé l’indexation mobile-first. Cela signifie que les pages indexées par Google seront basées sur la version mobile de votre site. Par conséquent, les performances de votre site sur des écrans plus petits auront le plus grand impact sur l’emplacement de votre site dans les SERPs.

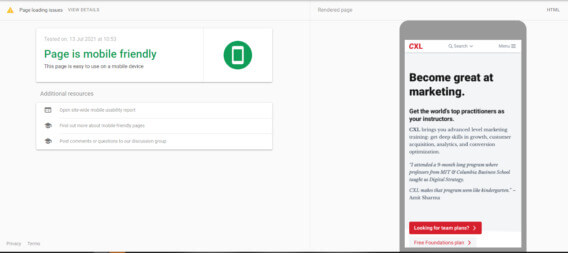

L’outil « Mobile-Friendly Test » de Google est un moyen simple de vérifier si votre site est optimisé pour les appareils mobiles.

Si vous utilisez un design responsive ou mobile-first, vous n’avez aucun souci à vous faire. Les deux sont développés pour s’afficher sur des écrans plus petits et toute modification apportée à la suite de votre audit SEO technique améliorera les performances du site et des recherches sur tous les appareils.

Cependant, un design responsive ne garantit pas une excellente expérience utilisateur.

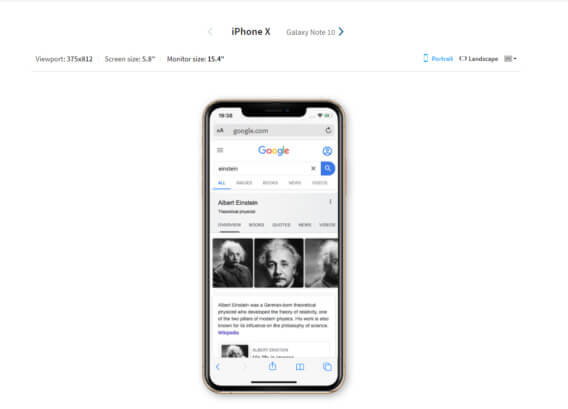

Vous pouvez tester votre site sur des appareils réels en utilisant l’outil responsive de BrowserStack.

Les sites mobiles autonomes devraient également passer le test de Google. Notez que des sites avec des versions distinctes pour le mobile et le desktop vous obligeront à vérifier les deux versions.

Les pages mobiles accélérées (AMP) constituent une autre option pour améliorer la vitesse des sites sur les mobiles. AMP est un projet soutenu par Google, conçu pour offrir aux utilisateurs des versions dépouillées de pages Web afin qu’elles se chargent plus rapidement que les pages HTML.

Google propose des tutoriels et des directives pour créer des pages AMP à l’aide d’un code ou d’un plugin CMS. Cependant, il est important d’être conscient de l’impact que cela aura sur votre site.

Chaque page AMP que vous créez est une nouvelle page qui existe parallèlement à l’original. Par conséquent, vous devez tenir compte de la façon dont elles s’intègrent dans votre schéma d’URL. Google recommande d’utiliser la structure d’URL suivante :

- votre-site-web.com/monarticle/amp

- votre-site-web.com/monarticle.amp.html

Vous devrez également vous assurer que des balises canoniques sont utilisées pour identifier la page principale. Il peut s’agir de la page AMP mais la page d’origine est préférable. En effet, les pages AMP servent une version basique de votre page Web qui ne vous permet pas de gagner des revenus publicitaires ou d’accéder au même niveau d’analyse.

Les pages AMP devront être auditées de la même manière que les pages HTML. Si vous êtes un abonné payant, Screaming Frog dispose de fonctionnalités pour vous aider à trouver et à corriger les problèmes d’AMP. Vous pouvez le faire dans la version gratuite mais vous devrez télécharger votre liste de pages.

4. Trouvez et corrigez les problèmes de contenu dupliqué et de cannibalisation des mots clés pour affiner le référencement Google.

À ce stade, votre audit de contenu a déjà commencé. L’ajout de balises canoniques permet de s’assurer que les pages principales ont une valeur SEO supérieure à celle des pages similaires. L’architecture du site aplanie rend votre contenu le plus important facile d’accès. Il s’agit maintenant d’affiner le référencement SEO.

Vérifiez que votre site ne contient pas de contenu dupliqué

Les pages qui contiennent des informations identiques ne sont pas toujours mauvaises.

L’exemple des pages de voitures de police miniatures que nous avons utilisé précédemment, par exemple, est nécessaire pour fournir aux utilisateurs des résultats pertinents.

Elles deviennent un problème lorsque la page est identique à celle pour laquelle vous essayez d’obtenir un classement.

Dans ce cas, vous mettez les pages en concurrence les unes avec les autres pour le classement et les clics, ce qui dilue leur potentiel.

Outre les pages de produits, les problèmes de contenu dupliqué peuvent survenir pour plusieurs raisons :

- Réutiliser des en-têtes, des titres de page et des méta-descriptions pour que les pages semblent identiques même si le corps du contenu ne l’est pas.

- Ne pas supprimer ou rediriger des pages identiques utilisées à des fins historiques ou de test.

- Ne pas ajouter de balises canoniques à une page unique ayant plusieurs URL.

Une exploration du site vous aidera à identifier les pages dupliquées. Vérifiez que le contenu ne contient pas de doublons :

- Titres

- Balises d’en-tête

- Méta-descriptions

- le contenu du corps du texte.

Vous pouvez alors soit supprimer ces pages, soit réécrire les éléments dupliqués pour les rendre uniques.

Fusionnez le contenu qui cannibalise des mots-clés similaires

La cannibalisation des mots-clés est similaire au contenu dupliqué dans la mesure où elle oblige les moteurs de recherche à choisir entre des contenus similaires. Donc Google va choisir d’eliminer un des deux au profit de l’autre.

Elle se produit lorsque vous avez divers contenus sur votre site qui se classent pour la même requête. Soit parce que le sujet est similaire, soit parce que vous avez ciblé les mêmes mots-clés.

Par exemple, disons que vous avez écrit deux articles. L’un sur « Comment rédiger une lettre de motivation » optimisé pour l’expression « comment rédiger une lettre de motivation » et l’autre sur « Conseils pour rédiger une lettre de motivation » optimisé pour « rédaction de lettre de motivation ».

Les deux articles sont suffisamment similaires pour que les moteurs de recherche aient du mal à déterminer lequel est le plus important.

En tapant sur Google « site : votredomaine.com + ‘motclé' », vous pourrez facilement déterminer si la cannibalisation des mots-clés est un problème.

Si vos articles sont classés au premier et au deuxième rang, ce n’est pas un problème. Mais si votre contenu est classé plus bas dans les SERPs, ou si un article plus ancien est classé au-dessus d’un article plus récent, il est probablement utile de les fusionner :

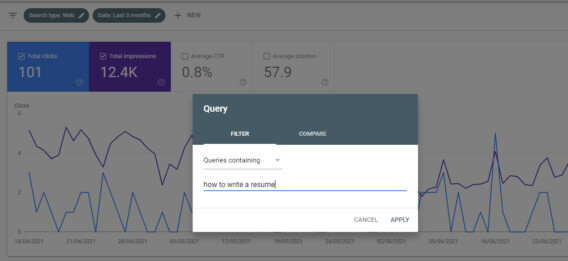

- Accédez à la section Performances de votre Google Search Console.

- Dans les filtres, cliquez sur Nouveau > Requête et entrez le mot-clé cannibalisé.

- Sous l’onglet Pages, vous pourrez voir quelle page reçoit le plus de trafic pour le mot-clé. Il s’agit de la page dans laquelle toutes les autres peuvent être fusionnées.

Cela ne fonctionnera pas pour toutes les pages. Dans certains cas, vous devrez envisager de supprimer le contenu qui n’est plus pertinent. Mais lorsque les mots-clés sont similaires, le fait de combiner le contenu contribuera à renforcer votre classement dans les moteurs de recherche.

Améliorez les balises de titre et les méta-descriptions pour augmenter votre taux de clics dans les SERP

Bien que les balises de titre et les méta-descriptions ne soient pas un facteur de classement, il est indéniable qu’elles ont un impact sur votre attractivité.

Ils sont essentiellement un moyen de faire de la publicité pour votre contenu.

Un audit technique de SEO est le moment idéal pour optimiser les anciens titres et descriptions, et combler les lacunes afin d’améliorer le taux de clics dans les SERP.

Les titres et les descriptions doivent être naturels, pertinents, concis et utiliser vos mots clés cibles.

Incluez les mots clés au début du titre et essayez de limiter le nombre de caractères à environ 60. Moz suggèrent que vous pouvez vous attendre à ce qu’à peu près 90% de vos titres s’affichent correctement s’ils sont inférieurs à cette limite.

De même, les méta-descriptions doivent comporter environ 155-160 caractères pour éviter la troncature.

Il convient de noter que Google n’utilisera pas toujours votre méta-description. En fonction de la requête de recherche, il peut extraire une description de votre site pour l’utiliser comme extrait. Vous n’avez aucun contrôle là-dessus. Mais si vos mots clés cibles sont présents dans vos balises méta, vous vous donnez un avantage sur les autres résultats qui recherchent des termes similaires.

Conclusion

La réalisation d’un audit SEO vous aidera à analyser les éléments techniques de votre site Web et à améliorer les zones qui nuisent aux performances de recherche et à l’expérience utilisateur.

Mais suivre les étapes de cet article ne fera que résoudre les problèmes que vous avez maintenant. À mesure que votre entreprise se développe, que votre site Web évolue et que les algorithmes de Google changent, de nouveaux problèmes liés aux liens, à la vitesse du site et au contenu apparaîtront.

C’est pourquoi les audits techniques doivent faire partie d’une stratégie permanente, parallèlement aux efforts de référencement naturel on-page et off-page.

Auditez votre site Web périodiquement ou chaque fois que vous effectuez des mises à jour structurelles ou conceptuelles de votre site.

Besoin d’un Audit SEO Technique ?

27 Avenue Taieb Mhiri

Immeuble Yasmina, bureau 17

2080 Ariana, Tunis, Tunisie

+216 22 774 450

Centre d'affaires TODA 2

Rue du Rhin Napoléon

67100 Strasbourg, France

+33 9 80 80 10 18

Rue du Port Franc, 2A

1003 Lausanne

Suisse

Avenue Mutsaard, 41

1020 Bruxelles

Belgique

+32 2 588 07 54